¿Qué es?

Es la configuración que define el “tamaño de la memoria activa” del modelo en cada ejecución. En la práctica, cuanto mayor es el contexto:- Más historial considera el modelo

- Mayor es el costo por ejecución

El Memory Economy Mode permite ajustar esto dinámicamente, priorizando economía o profundidad.

Antes de usar: lo que necesitas saber

Antes de cambiar esta configuración, vale la pena entender algunos puntos importantes:- Es una configuración por usuario: Cada usuario define su propia preferencia y tu elección no altera automáticamente la experiencia de otros miembros del Workspace

- Es una configuración global de tu experiencia en Tess: No aplica solo a un único chat, el ajuste pasa a influir en tus conversaciones en la plataforma de forma general, ni se convierte en una configuración por Prompt.

- No necesitas redefinir esto en cada nueva conversación: Una vez ajustada, la preferencia continúa activa hasta que la cambies de nuevo, el objetivo principal es equilibrar calidad y costo

Más contexto mejora la retención del historial. Menos contexto reduce el gasto de tokens, especialmente en chats largos

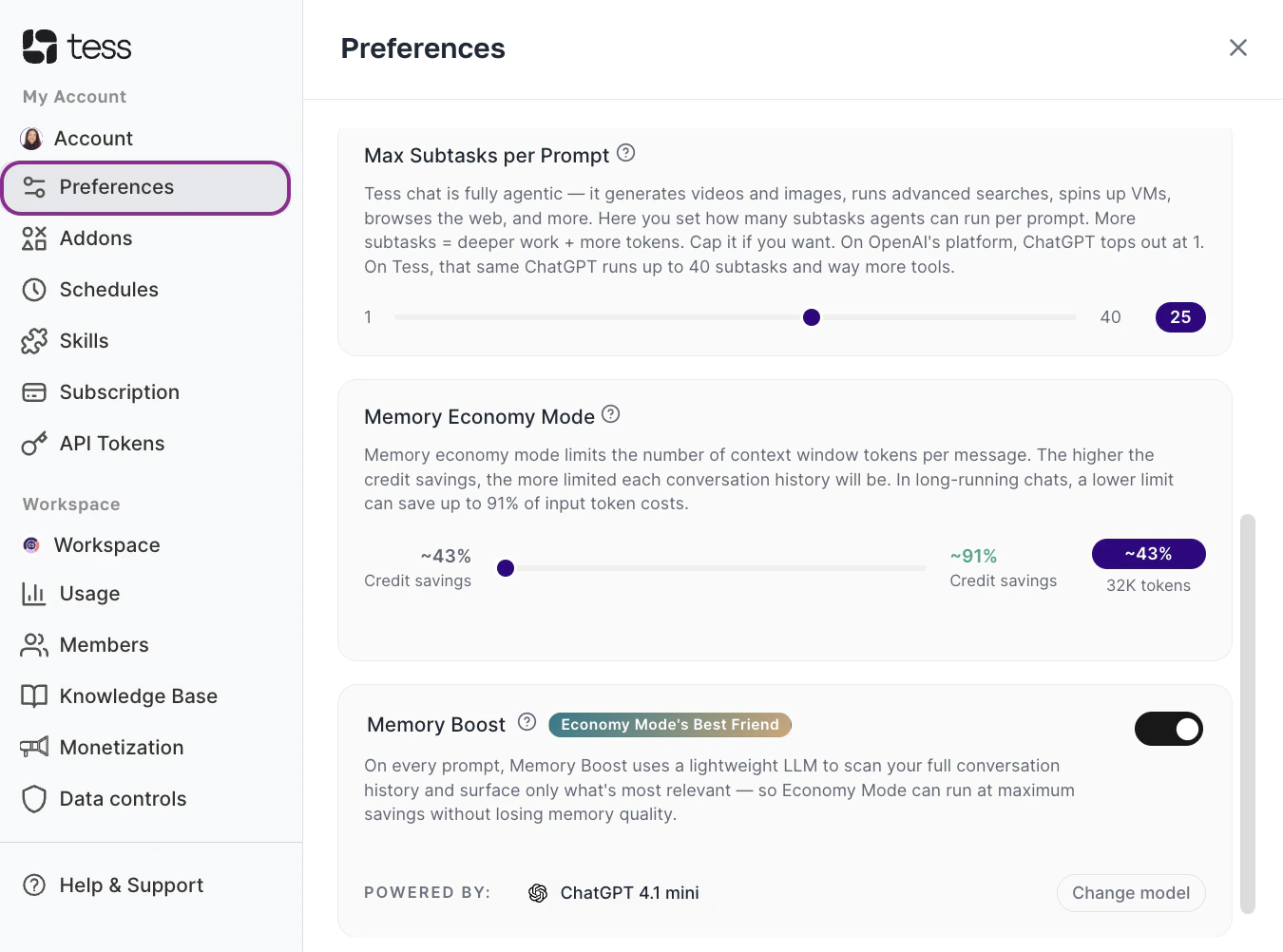

¿Dónde encontrarlo?

Accede a Preferencias

En la esquina inferior izquierda, haz clic en tu ícono de usuario y accede a la opción de configuraciones > preferencias.

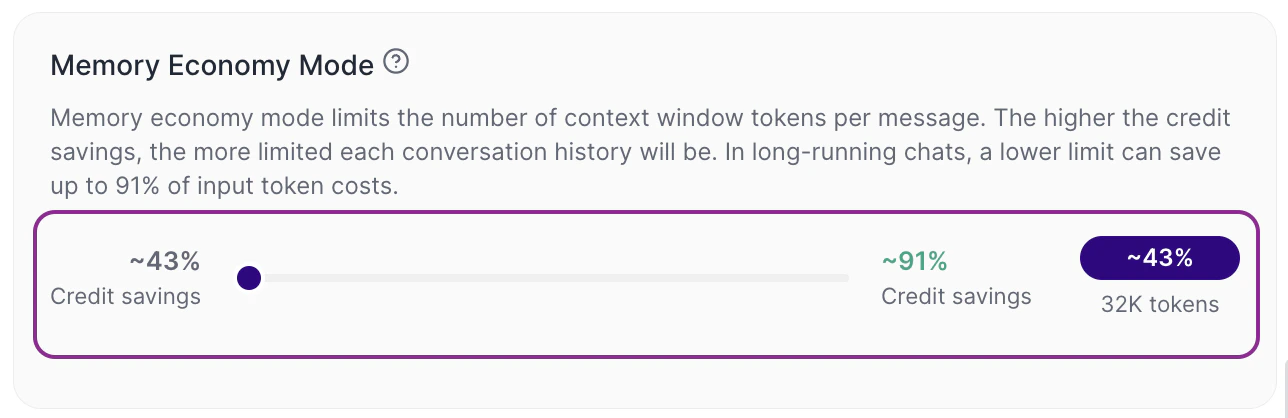

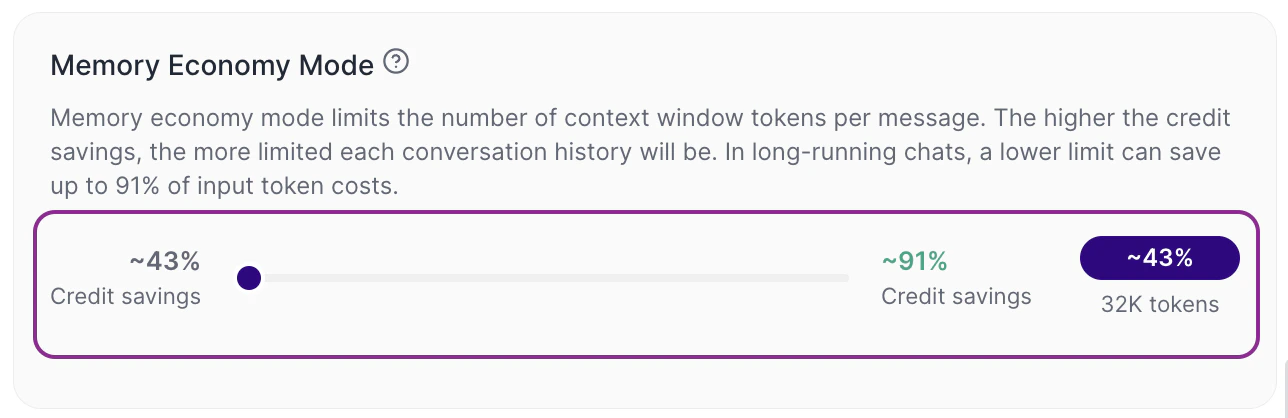

Ajusta el Slider

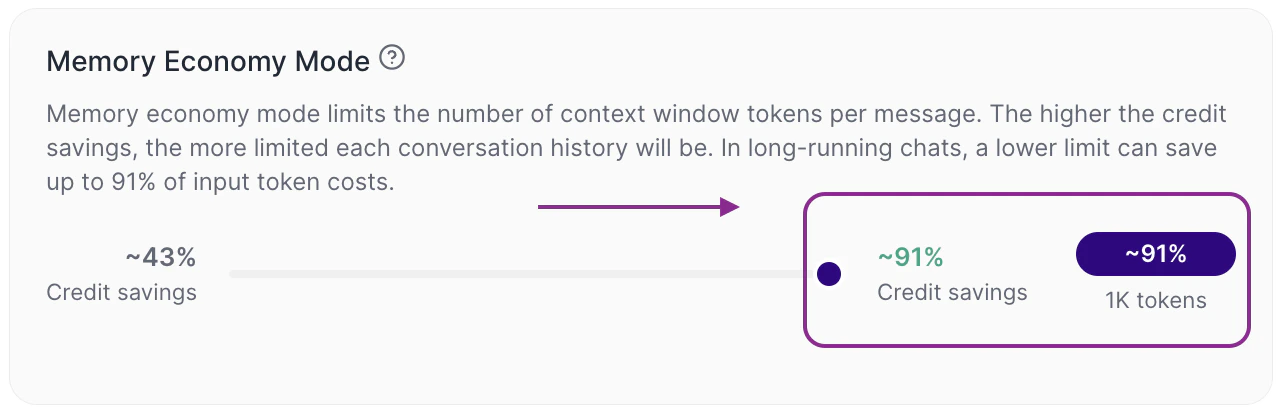

- Más a la derecha → más economía

- Más a la izquierda → más contexto (ej: el predeterminado y la ventana de 32K tokens)

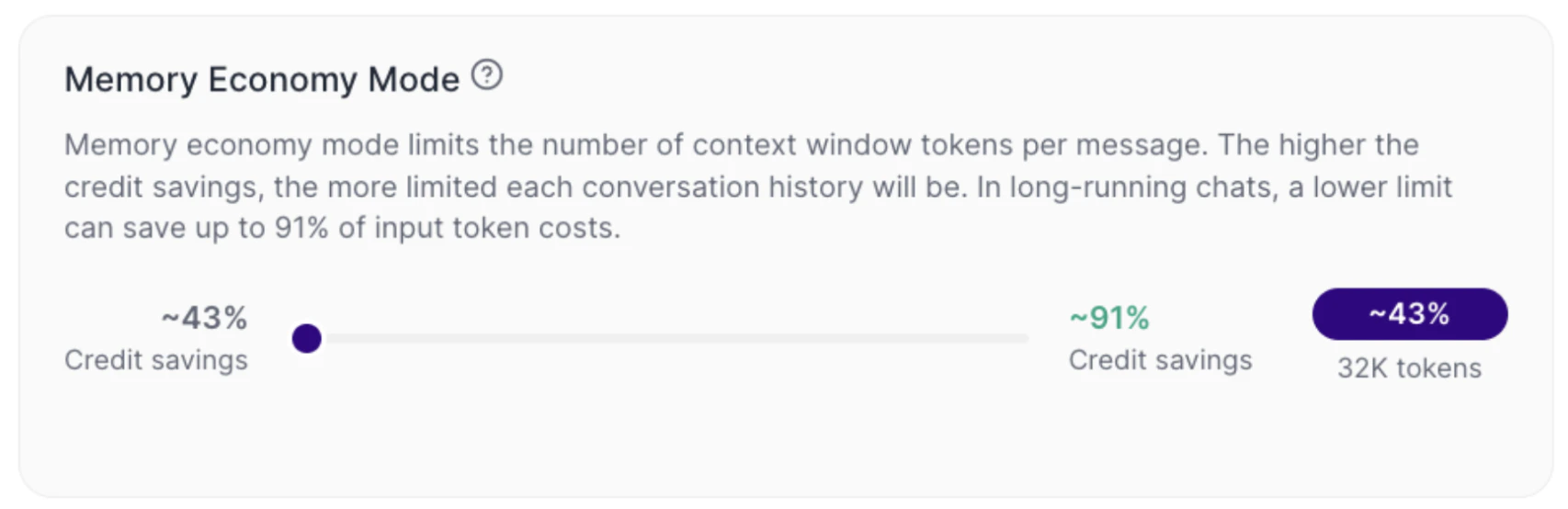

Cómo interpretar el Memory Economy Mode

El Memory Economy Mode funciona como un control entre la economía y la profundidad de contexto.Cuando el slider está más orientado a la economía (derecha)

Tess limita más fuertemente la cantidad de tokens por mensaje. En la práctica, el costo tiende a caer, el historial útil que utilizará el LLM de la conversación se hace menor, los chats largos pueden perder continuidad más temprano. La configuración predeterminada es de 32K tokens, 43% de ahorro de créditos.

Cuando el slider está más orientado al contexto (izquierda)

Tess amplía el límite disponible por mensaje. En la práctica, más historial puede ser considerado por el LLM, la continuidad tiende a mejorar y el costo de entrada (input token) tiende a subir, después de todo, es mucho más contenido siendo revisado por el modelo de texto para componer su memoria.En la propia interfaz, verás indicadores como:

- porcentaje estimado de ahorro de créditos

- límite de contexto aproximado, como 32K tokens

Cómo funciona esto en la práctica

En general, esta configuración es más relevante en conversaciones largas. En un chat corto, la diferencia puede ser pequeña. Sin embargo, en un chat que acumula mucho historial, el límite de contexto pasa a importar más, porque el modelo no puede considerar todo indefinidamente. Esto significa que, en conversaciones extensas:- con un contexto menor, las partes antiguas pueden dejar de ser consideradas

- con un contexto mayor, la continuidad tiende a ser mejor

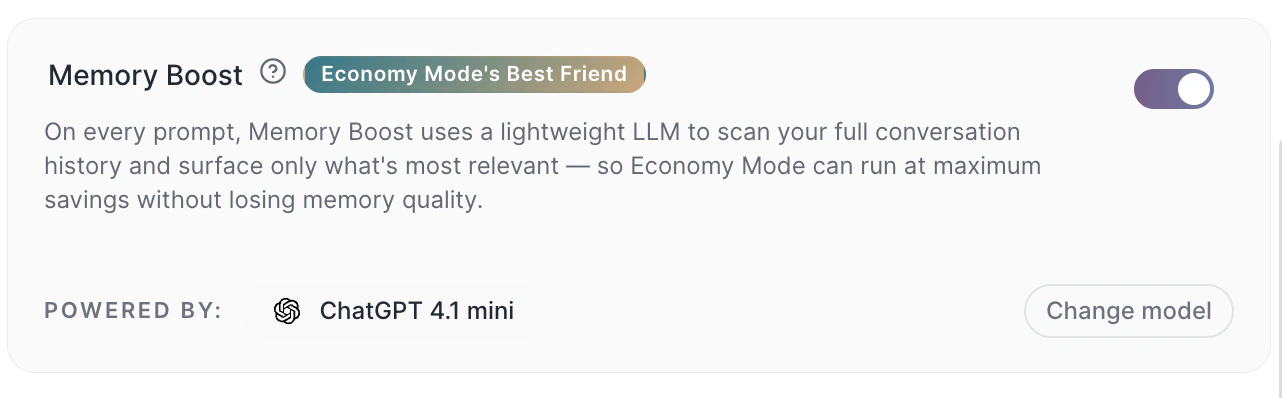

- con el Memory Boost activo, Tess puede recuperar fragmentos relevantes del historial incluso manteniendo un límite más económico

La ventana de contexto no es solo una configuración técnica. Cambia el comportamiento real de la IA a lo largo del uso.

Esto significa que la plataforma controla cuánto historial se enviará efectivamente al modelo en cada nueva interacción.

Por eso, el ajuste del Memory Economy Mode funciona como una política individual de uso: tú decides priorizar más economía o priorizar más retención del historial. Este control es especialmente útil para quienes quieren escalar el uso de Tess con más previsibilidad de costo.Además, el límite definido impacta todos los mensajes del chat y los modelos que se utilicen para conversar. Sin embargo, al activar el Max Mode, el modelo ignora esta configuración y usa el límite máximo nativo de cada modelo.

Ejemplos prácticos de contexto y configuraciones

Ejemplo 1: uso rápido y operativo Si usas Tess para tareas como revisar textos cortos, responder dudas objetivas o generar pequeñas variaciones de contenido, por ejemplo, un modo más económico suele ser suficiente.Ejemplo de Prompt:Ejemplo 2: conversación estratégica y continua Si estás usando Tess para construir un plan a lo largo de varias interacciones madurar un análisis o trabajar en un proyecto con contexto acumulado, un contexto mayor tiende a funcionar mejor.

“Reescribe este párrafo en un tono más profesional.” En este caso, no hay necesidad de mantener mucho historial de la conversación.

Ejemplo de Prompt: “Considera todo lo que hemos discutido hasta aquí y organiza una propuesta final en temas.” Aquí, la continuidad hace la diferencia en el resultado, puede ser importante revisar tu límite máximo.Observaciones importantes

- Más contexto = mayor consumo de créditos

- Menos contexto puede hacer que la IA “olvide” partes de la conversación

- El impacto es mayor en chats largos

- El valor exhibido (ej: 32K tokens) es un límite aproximado

Errores comunes

- Dejar el contexto alto para todo: Esto aumenta el costo incluso en tareas simples que no necesitan de un historial largo.

- Dejar el contexto muy bajo en chats estratégicos: Esto puede perjudicar la continuidad y generar respuestas menos consistentes a lo largo de la conversación.

- Tratar esta configuración como algo por chat: El ajuste se realiza en las preferencias del usuario e influye ampliamente en la experiencia en la plataforma.

- Ignorar el impacto en los créditos: Cuanto más contexto se use por mensaje, mayor tiende a ser el costo de entrada en conversaciones largas.